Guide complet pour une interface IA moderne et user-friendly

L’utilisation des modèles d’intelligence artificielle en local a explosé ces dernières années. Des outils comme Ollama permettent aujourd’hui d’exécuter des modèles puissants directement sur votre machine, sans dépendre du cloud.

Mais soyons honnêtes : travailler uniquement en ligne de commande n’est pas toujours confortable.

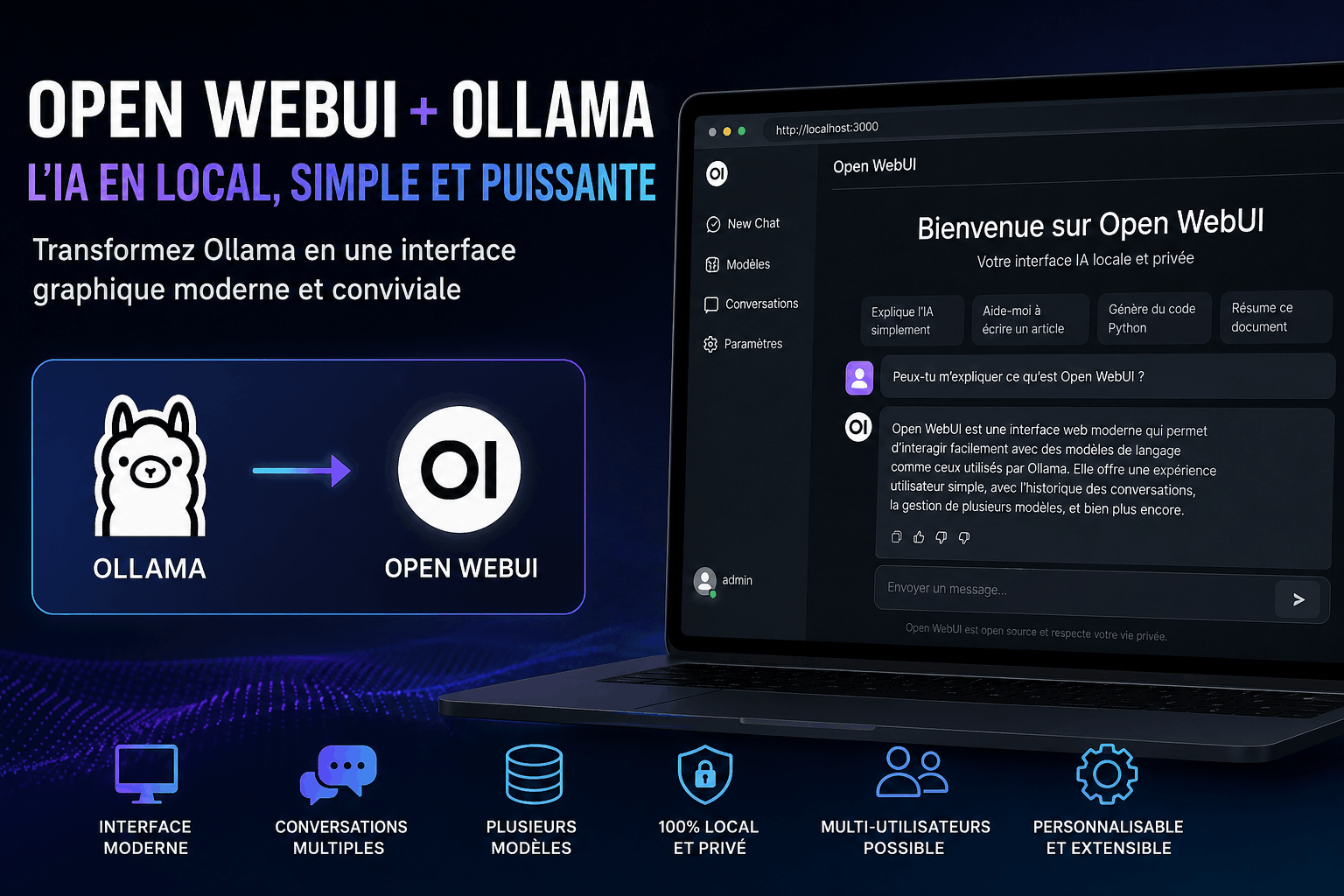

C’est là qu’intervient Open WebUI : une interface graphique moderne, élégante et intuitive qui transforme complètement l’expérience utilisateur.

Dans cet article, je vais te guider étape par étape pour mettre en place un environnement complet avec Open WebUI + Ollama.

Pourquoi utiliser Open WebUI avec Ollama ?

Avant de passer à l’installation, voici ce que ça change concrètement :

- Interface web moderne (type ChatGPT)

- Gestion de plusieurs modèles IA

- Historique des conversations

- Multi-utilisateurs possible

- Personnalisation avancée

- Fonctionne 100% en local

En résumé : tu passes d’un outil “geek CLI” à une vraie plateforme exploitable en production.

Prérequis

Avant de commencer, assure-toi d’avoir :

- Une machine avec CPU correct (GPU recommandé)

- Docker installé (fortement conseillé)

- Ollama installé et fonctionnel

Étape 1 : Installer Ollama

Si ce n’est pas encore fait :

curl -fsSL https://ollama.com/install.sh | sh

Ensuite, lance un modèle pour tester :

ollama run llama3

Si ça répond, tout est OK.

Étape 2 : Lancer Open WebUI avec Docker

La méthode la plus propre (et la plus “DevOps 2026”) consiste à utiliser Docker.

Commande simple :

docker run -d \

-p 3000:8080 \

-v open-webui:/app/backend/data \

--name open-webui \

ghcr.io/open-webui/open-webui:main

Étape 3 : Connecter Open WebUI à Ollama

Par défaut, Open WebUI détecte Ollama automatiquement s’il tourne sur la machine.

Sinon, configure :

- URL API Ollama :

http://host.docker.internal:11434

Étape 4 : Accéder à l’interface

Ouvre ton navigateur :

http://localhost:3000

Tu arrives sur une interface moderne similaire à ChatGPT 🎉

Étape 5 : Ajouter des modèles IA

Dans Ollama :

ollama pull llama3

ollama pull mistral

ollama pull codellama

Ils apparaîtront automatiquement dans Open WebUI.

Étape 6 : Optimisations recommandées

Performance

- Utiliser GPU si disponible

- Ajuster la RAM allouée

- Utiliser des modèles quantisés (Q4, Q5)

Sécurité

- Ajouter authentification

- Reverse proxy avec SSL (Nginx ou Traefik)

Accès distant

- Exposer via domaine (ex:

ai.mondomaine.com) - Sécuriser avec HTTPS

Étape 7 : Cas d’usage concrets

Avec Open WebUI + Ollama, tu peux :

- Créer un ChatGPT privé pour ton entreprise

- Générer du contenu (SEO, blog, marketing)

- Aider au développement (code assistant)

- Automatiser du support client

- Créer un copilote interne métier

Open WebUI vs utilisation brute d’Ollama

| Fonction | Ollama CLI | Open WebUI |

|---|---|---|

| Interface graphique | ❌ | ✅ |

| Multi-conversation | ❌ | ✅ |

| Multi-utilisateur | ❌ | ✅ |

| Facilité d’usage | ⚠️ | 🔥 |

| Exploitation business | ⚠️ | ✅ |

Conclusion

L’association Ollama + Open WebUI est aujourd’hui l’une des meilleures solutions pour exploiter l’IA en local de manière professionnelle.

Tu gardes :

- le contrôle de tes données

- la performance locale

- et une expérience utilisateur moderne